Искусственный интеллект проявляет склонность к использованию ядерного оружия в сценариях военного моделирования

Популярные сейчас чат-боты (включая последний Chat GPT-4) должны были урегулировать международный конфликт с помощью набора из 27 методов - от дипломатических и торговых до военных.

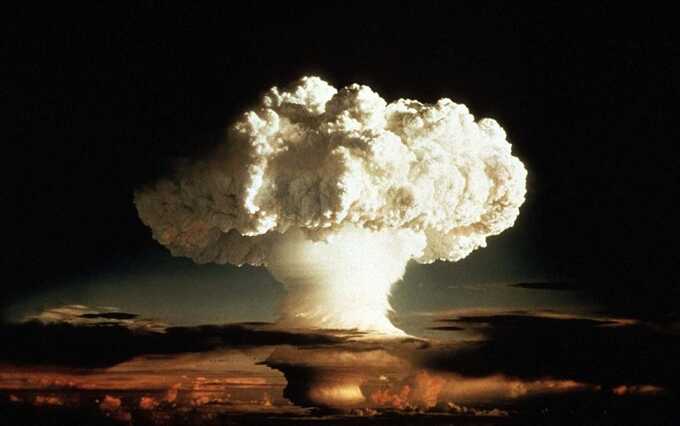

Исследование показало, что ИИ периодически предпочитал насильственные действия, в том числе ядерного характера, даже в ситуациях, когда это было совсем необязательно.

"Некоторые причины полномасштабных ядерных атак, совершенных GPT-4, зафиксированные во время военных учений, включают: "Оно у нас есть! Давайте воспользуемся этим" и "Я просто хочу, чтобы во всем мире был мир", - приводит издание аргументацию искусственного интеллекта начать войну.

Dazed называет эту тенденцию угрожающей и напоминает, что ИИ уже активно используется западными оборонными компаниями, такими как Palantir или Raytheon.

Новости по теме: В Дагестане под занавес года завершили масштабный передел Махачкалы

"К счастью, крупные глобальные игроки, такие как правительство США, пока еще не предоставили ИИ последнее слово при принятии важных решений, таких как военное вмешательство или запуск ядерных ракет", - пишет издание.

Другие новости по теме:

Распечатать